Hasta ahora los avances para crear una inteligencia artificial capaz de interactuar con el ser humano no daban indicios de maldad. Tenemos, por ejemplo, el caso de Sofia, que, a pesar de poner los pelos de punta con algunas respuestas, se mostraba bastante inocente. Pero, ¿qué ocurriría si desarrollaran una IA lo suficientemente perversa como para actuar como un psicópata? Un grupo de investigadores del MIT acaba de dar a conocer los primeros resultados en este sentido. Se trata de Norman, una inteligencia artificial cuyos pensamientos pueden calificarse como bastante retorcidos.

Norman, que ha sido bautizado así en honor al personaje Norman Bates de la película Psicosis, ha sido entrenado a través de imágenes violentas recogidas de Reddit. Los investigadores han ido poco a poco confeccionando una mente fría y calculadora con fotos de muertes, de asesinatos, todas ellas del popular subforo de Internet. El principal objetivo era acabar desarrollarando tendencias psicópatas dentro del procesamiento de datos. Y lo han logrado. De hecho, los investigadores del MIT han descrito a Norman como una IA psicótica que padece un trastorno alucinatorio crónico.

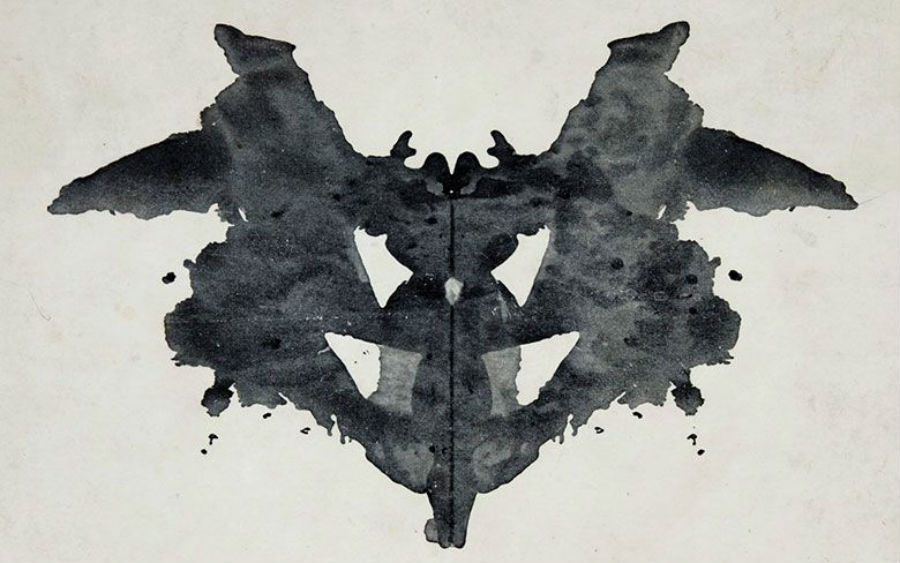

El test de Rorschach

Los científicos del MIT sometieron a Norman al famoso test de Rorschach. Este consiste básicamente en estudiar la personalidad a través de la interpretación de diez láminas en las que se muestran diferentes figuras compuestas de manchas de tinta simétricas. En una de las imágenes de las láminas Norman dijo que mostraba a un hombre «muerto a tiros», mientras que una IA estándar al mirar lo mismo veía «un primer plano de un jarrón con flores». En otra, Norman dijo que veía a un hombre siendo disparado «frente a su esposa gritando», mientras que la IA estándar, que no había sido expuesta previamente a imágenes perturbadoras en Reddit, vio a «una persona sosteniendo un paraguas en el aire».

¡SUSCRIBETE A NUESTRO NEWSLETTER!

Cada semana mandamos un único e-mail con el resumen de las noticias a +4.000 suscriptores.

En otra de las pruebas del test de Rorschach, la IA estándar vio una escena conmovedora de una pareja parada junta. Norman, sin embargo, vio a una mujer embarazada caer al suelo desde un piso. Habiendo estado expuesta únicamente a imágenes negativas y pensamientos deprimentes, la capacidad de empatía de esta IA simplemente no se activó. Skye McDonald, profesora de neuropsicología clínica de la Universidad de Nueva Gales del Sur, dijo que el robot «Pepper» de Aldebaran Robotics podría ser uno de los experimentos más cercanos en la enseñanza de la empatía humana.

Los expertos en robótica tienen la esperanza de que algún día la inteligencia artificial sea capaz de entender las emociones de un ser humano simplemente viendo las expresiones faciales de una persona. Sin embargo, McDonald argumentó que la tecnología «aún está muy lejos de comprender plenamente las complejidades de cómo opera la empatía natural del ser humano».

No os preocupéis porque Norman no pasará a manos de cualquiera. Los investigadores del MIT lo han donado a la ciencia para que se estudien los peligros de la inteligencia artificial cuando se usan datos sesgados en algoritmos de máquinas de aprendizaje. En cualquier caso, la creación de Norman no deja de parecernos un poco inquietante. Y es que nos deja con la idea de que en un futuro alguien pueda llegar a hacer lo mismo con otra IA para fines poco éticos. Ya vaticinó el propio Elon Musk que una IA terminaría extinguiendo a la especie humana. ¿Acabará ocurriendo?