El Departamento de Defensa de los Estados Unidos ha estado trabajando con Google, codo con codo, en el desarrollo de drones con usos militares en un plan denominado ‘Proyecto Maven‘. Dicho proyecto enfoca sus esfuerzos en desarrollar y fortalecer la Inteligencia Artificial de aviones teledirigidos, para que fuesen capaces de identificar entre objetos y personas del campo enemigo. La cuestión ética pronto salpicó a los empleados de Google que furibundos, firmaron una petición que clamaba por la salida de la gran G del infame proyecto Maven. La compañía hizo vencer su contrato con el Departamento de Defensa el pasado mes de marzo tras la renuncia de una docena de sus empleados.

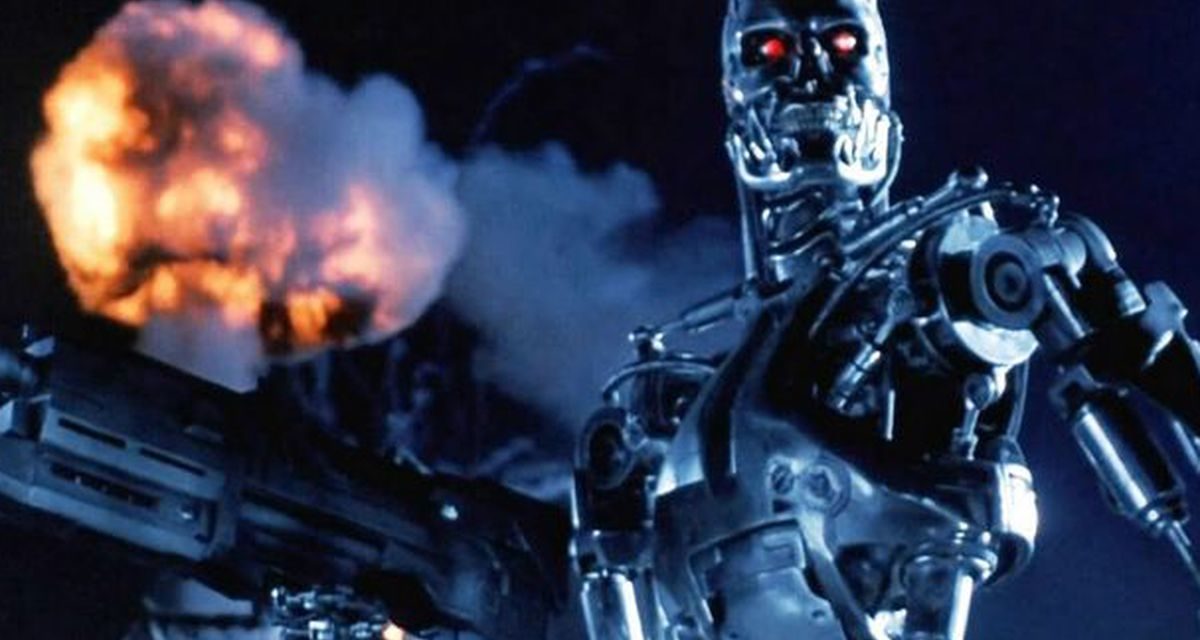

Armas autónomas con capacidad de decisión, ¿la rebelión de las máquinas?

Laura Nolan es el nombre de una de esas empleadas que salió del proyecto tras cuestionarse la valía ética del mismo. Su principal cometido en el proyecto Maven era el de ‘ingeniero de confianza’. Según declaraciones de la propia Maven:

«Aunque no participé directamente en la aceleración del reconocimiento de las imágenes de vídeo, me di cuenta de que seguía siendo parte de la cadena de asesinatos; que esto, en última instancia, llevaría a más personas a ser atacadas y asesinadas por el ejército estadounidense en lugares como Afganistán«.

Según la propia experiencia de Laura Nolan en el Poyecto Maven, el próximo paso natural del Departamento de Defensa sería el de crear armas completamente autónomas guiadas por Inteligencia Artificial. La propia Nolan teme que «lo que se está viendo son posibles atrocidades y asesinatos ilegales incluso bajo las leyes de la guerra, especialmente si se despliegan cientos o miles de estas máquinas«.

El peligro de construir armas autónomas que dependieran de la tecnología de Inteligencia Artificial es evidente. Numerosos factores pueden incidir en el sistema y provocar que estas armas manifestaran un comportamiento impredecible, como las interferencias de señales de radar inesperadas, las inclemencias meteorológicas o que las armas sean portadas por personas con intenciones distintas a las del ataque en guerra para conseguir la estabilidad. La ingeniera advierte que «la máquina no tiene el discernimiento ni el sentido común que tiene el toque humano«.

Ya existen países con armas inteligentes

Otro de los motivos por los que debemos temer al Proyecto Maven es que estas armas se probarían en los propios campos de batalla. Es más, Nolan no puede asegurar que no se estén ya probando armas autónomas con Inteligencia Artificial en algún conflicto bélico:

«El otro factor espeluznante de estos sistemas de guerra autónomos es que sólo se pueden poner a prueba desplegándolos en una zona de combate real. Tal vez esté pasando ya con los rusos en Siria, en este momento… ¿quién sabe? Lo que sí sabemos es que en la ONU Rusia se ha opuesto a cualquier tratado y mucho menos a la prohibición de estas armas»

Ningún país ha declarado, por el momento, que estén trabajando en armas con Inteligencia Artificial en estos momentos. Lo que sí está claro es que muchos países tecnológicamente desarrollados están construyendo efectivos que integrar en su armamento que dispongan de las últimas tecnologías. Por ejemplo, la marina estadounidense dispone de un buque de guerra con piloto automático que puede llevarse meses bajo el mar sin tripulación e Israel presume de disponer de drones que son capaces de identificar objetivos de forma autónoma aunque aún requieran de un ojo humano para dar el visto bueno al ataque.