YouTube, esa descomunal plataforma para compartir vídeos a medio camino entre enclave cultural y herramienta de marketing. Un ente tan descomunal que él solo aglutina prácticamente la mitad de usuarios totales en la red o, dicho de otra manera, casi el 30% de la población mundial.

Si bien en los inicios su política era más laxa a la hora de imponer su criterio sobre qué podía publicarse o postear, lo cierto es que, de un tiempo a esta parte, YouTube ha estado endureciendo sus propias normas para evitar determinados temas sensibles. Sin ir más lejos, hace unas semanas volvió a actualizar su política de monetización sobre ‘eventos delicados’, para incluir cualquier referencia a la actual crisis sanitaria en su lista negra.

¿Pero cómo puede definir Youtube los comentarios que son inapropiados? ¿Qué o quién define qué palabras y frases son potencialmente ‘peligrosas’? El paso número uno es entender los mecanismos de los que se vale la plataforma para intentar entender cómo funciona la censura en los comentarios de Youtube.

¡SUSCRIBETE A NUESTRO NEWSLETTER!

Cada semana mandamos un único e-mail con el resumen de las noticias a +4.000 suscriptores.

¿Cómo funciona la censura en YouTube?

Debido a los más de 2.000 millones de usuarios activos en Youtube, es necesario una forma de automatizar el control sobre la actividad de todos estos perfiles. Este mecanismo adopta la forma de un sistema informatizado altamente sofisticado controlado por una IA que se encarga de rastrear, perfilar y clasificar el contenido y la actividad de todas aquellas personas que se encuentran en el sitio.

Este impresionante sistema utiliza el aprendizaje automático para detectar, no solo las palabras, sino también las expresiones que podrían ser inapropiadas.

No hablamos solamente de un algoritmo en el sentido estricto, que simplemente bloquee un determinado comentario en base a una lista de palabras ‘prohibidas’. Que va, esto va mucho más allá. Hablamos más bien de un modelo computacional basado en el machine learning que toma millones de muestras de comentarios previamente moderados por el propietario de un canal u otro usuario.

No nos entendáis mal, claro que existe un listado de palabras prohibidas y controladas por un algoritmo, pero no menos importante son todas las herramientas y recursos que Youtube pone a disposición de la comunidad para reportar determinadas conductas inapropiadas. Todo este input que proviene de los usuarios es de lo que se alimenta el sistema de análisis de datos de la plataforma para controlar de manera mucho más eficaz y precisa la actividad dentro de la comunidad.

Es decir, el gran hermano es una combinación de algoritmo que automatiza la búsqueda de palabras clave, machine learning y la acción responsable de la comunidad de Youtube. Todos esos términos y expresiones que serán potencialmente objeto de censura, están recogidos en el apartado de ‘Normas de seguridad’ de la plataforma.

Todo este conjunto de reglas trata de evitar contenidos especialmente dañinos, peligrosos, pornográficos, de incitación al odio, con derecho de autor, etc.

La censura en números

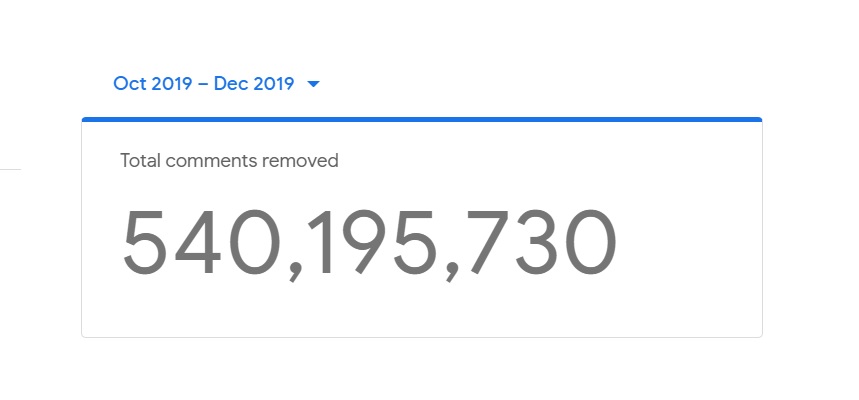

Para que os hagáis una idea de lo eficaz que resultan las herramientas descritas más arriba, solo tenéis que echar un vistazo al número de comentarios eliminados solo en el último trimestre de 2019 (el último del que se tiene registro). Hablamos de un total de 541 millones de comentarios borrados.

También podéis echar un vistazo al porcentaje de comentarios eliminados por el propio sistema de Youtube y aquellos borrados o bloqueados directamente por los propios youtubers (que no usuarios). Otro dato interesante es el porcentaje de comentarios eliminados en base a una temática concreta.

Faltó aclarar un pequeño detalle: anda pésimo!!

Pues si uno no puede pensar lo que piensa ya no es libre, no es lo mismo pensar libremente que ame…mazar y YouTube censura también los comentarios inofensivo divos por ejemplo escribí un comentario que decía que antes de expropiar nuestros bancos que expropien primero el dinero em B de los multimillonarios monarquías absolutas fuera de Europa solo por decor eso me pausaron los comentarios cosa que lo qie dije lo dice todo el pueblo de esos países es verdad no son calumnias, que los que más deberían ser controlados sus ahorros son esos no los pobres ciudadanos con cuatro duros en el banco pues que alguien diga donde esta la ofensa si eso es un secreto a gritos

Alucino que por usar la palabra «infantil» en un comentario (me acaba de pasar), Youtube te lo borre automáticamente… Si esto va con I.A., es realmente imbécil la I.A. que tienen. Con tanta censura en todos los lados a uno se le quitan las ganas de intentar participar en nada, se descontextualiza todo y así nos va.

Aun va más allá, youtube oculta los comentarios a los demás, tú puedes hacer un comentario y si Youtube le parece «necesario» lo oculta sin que lo sepas, tú lo puedes ver y pensar que todos lo pueden ver también, pero lo que no sabes es que ese comentario solo lo puedes ver tú en tu cuenta, pues si te metes con otra cuenta y revisas donde dejaste ese comentario no aparece, está oculto, Youtube nos quiere ver la cara, censura la libertad de expresión y nadie se da cuenta.

los de YouTube se merecen un hechizo bien hecho para hacerles caer su imperio por opresores ocultan comentarios cusndo les parece los detesto con toda mi alma

La forma de cesura es muy desarrollada. El artìculo no cumple con informar còmo se produce esto.

Los usuarios que Youtube realmente censura, son aquellos cuyos comentarios no los ve sino sólo quien los escribe —y Youtube no le informa ni una sola palabra. Para el sensurado todo sigue normal… pero nadie puede ver lo que comenta. Eso hace Youtube porque la persona que ellos no quieren comentando, NO ha quebrado ninguna ley, ninguna norma, ninguna regla establecida. Pero a Youtube no quiere que la opinión en el comentario sea leída. Eso hace Youtube por razones ideológicas y para reprimir la amplitud del pensamiento. Youtube es un negocio para hacer dinero (ellos), no una plataforma para exponer ideas.

No aparece si los filtra como mas importante , si aparece por más reciente . Lo comprobé con doble cuenta

Por más importante normalmente aparece una retahíla de estupideces .

Al final borro todos los que censura y los que le da la gana publicar

YouTube es comunista no es democrática se ha vuelto una censura indiscriminada insoportable a tal punto que elimine la app y nunca más volveré a usarla

Puedes ver si bloquean tus comentarios cerrando sesión y yendo al sitio donde aparentemente está tu comentario. Si no lo ves, los demás tampoco.

Llegando a Android la red Trump Social debemos emigrar, YouTube censura al servicio de la izquierda inmoral. Escribí ,mujer hermosa y lo eliminó,una locura y desvergonzado.Rumble ya me fui.

Aun va más allá, youtube oculta los comentarios a los demás, tú puedes hacer un comentario y si Youtube le parece «necesario» lo oculta sin que lo sepas, tú lo puedes ver y pensar que todos lo pueden ver también, pero lo que no sabes es que ese comentario solo lo puedes ver tú en tu cuenta, pues si te metes con otra cuenta y revisas donde dejaste ese comentario no aparece, está oculto, Youtube nos quiere ver la cara, censura la libertad de expresión y nadie se da cuenta.

Todo radica que los demócratas tienen el control de esta plataforma comunista.Ponernos de acuerdo e irnos a Rumble u otra.

Da risa como ambos bandos del esoecteo acusan a youtube de censura, porque la izquierda lo acusa de censurar comentarios que vayan contra el neoliberalismo. ¿No se están dando cuenta de que están tan polarizados que ya están viendo enemigos en todas partes mientras que los líderes políticos se pelean en público y se dan la mano en privado? Increíble cómo puede haber tanto incauto suelto

Yo no tengo ninguna ideología politoca ni me interesa la politoca y he sufrido en mis carnes la censura de YouTube esa plataforma es comunista no acepta el pemsamiento libre es opresora del pensamiento me censuran comentarios inofensivos son detestables ojalá caiga su imprrio estalinistas